AVC ou crise de panique ? Le danger des biais dans la santé

François Manens

Ce contenu est réservé aux abonnés La Tribune

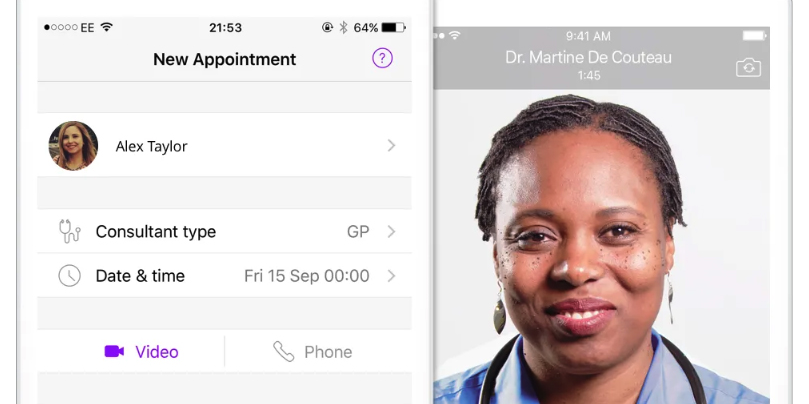

Le chatbot Babylon permet aux assurés britanniques de poser leurs questions par visioconférence (photo) ou par Tchat. DR.

DR

François Manens

Ce contenu est réservé aux abonnés La Tribune

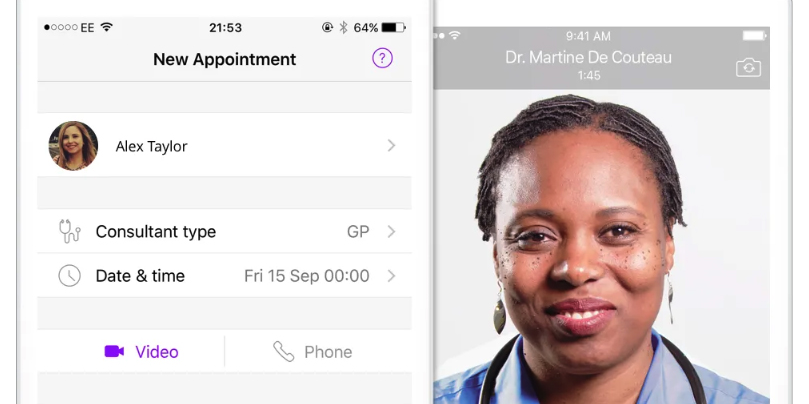

Le chatbot Babylon permet aux assurés britanniques de poser leurs questions par visioconférence (photo) ou par Tchat. DR.

DR

Avec 500 millions de dollars levés en avril, un partenariat avec le English National Heal Service (NHS) - la Sécu anglaise -, et déjà plus de quatre millions d'utilisateurs, la startup de télémédecine Babylon fait figure de pionnière. Pourtant, son chatbot est régulièrement décrié par des spécialistes du secteur. Le robot pose plusieurs questions à choix multiples à l'utilisateur afin de faire une prédiction de la maladie qu'il pourrait avoir, et lui suggère où aller se faire soigner.

Vidéo à l'appui, le Dr Murphy, un utilisateur anonyme de Twitter qui s'identifie comme un consultant de la NHS, a fait deux tests : le premier avec un profil d'homme, le second avec un profil de femme, tous deux âgés de 59 ans et fumeurs. Dans les deux cas, il a déclaré au chatbot souffrir de deux symptômes communs aux accidents cardiovasculaires : une forte douleur au niveau de la poitrine et des nausées. Surprise : le verdict de l'IA diverge selon le sexe. Avec son profil d'homme, le chatbot identifie les signes de deux conditions cardiaques (la péricardite et l'angor instable), et recommande à l'utilisateur d'aller se faire traiter aux urgences. Pour la femme, les deux premiers résultats suggèrent une crise de panique, traitable à domicile, ou une dépression, pour laquelle le chatbot propose de consulter un généraliste...

À lire également

Cette différence de diagnostic entre les genres correspond-elle à une réalité médicale ? Une étude menée par des chercheurs de l'Université d'Édimbourg et financée par la British Heart Foundation, conclut pourtant que certains symptômes sont les mêmes pour les deux sexes. La startup mettrait-elle alors les femmes en danger ? « Notre système est entraîné avec les meilleures données cliniques existantes, et est soutenu par des experts du sujet. Le résultat indique ce que les données médicales suggèrent qu'il arrivera », a balayé d'un revers de main un porte-parole de la startup sur Twitter, avant de pondérer : « Des effets de biais peuvent être présents dans les données de recherches. » Or, la prise en compte des biais est cruciale pour créer une IA - ici, un chatbot - inoffensive. « C'est un problème récurrent : les biais humains viennent biaiser les données d'études. Comme l'algorithme apprend de ces données, il apprend les erreurs humaines et les reproduit », explique Walid Benbihi, senior data scientist chez Artefact.

François Manens

Un incident majeur toutes les deux heures : les risques cyber explosent dans la finance européenne

448 TWh d'électricité par an, 4.500 milliards de litres d’eau : les coûts cachés de la révolution de l’IA

Meta recule sur son outil de surveillance des salariés pour entraîner son IA

Bruxelles dévoile son grand plan pour la souveraineté technologique, avec des instruments encore timides