Une dizaine de clics, et c'est terminé. Créer un modèle prédictif sur Tada, le logiciel de MyDataModels, ne coûte pas un grand effort. D'autant plus qu'il n'est pas nécessaire d'être un spécialiste de la data, ni d'utiliser des jeux de données de taille gigantesque. Il suffit simplement de connaître les enjeux de son métier. Grâce à ses algorithmes maison, MyDataModels compte s'imposer sur un marché encore peu exploité, celui de l'analyse de petits jeux de données.

Si l'exploitation des big data, ces gigantesques jeux de données, a déjà fait éclore ses champions, les méga-données ne sont que la partie émergée de l'iceberg. MyDataModels préfère se concentrer sur la partie immergée, les petits jeux de données, qui représenteraient, d'après la startup, 80% de l'ensemble des données. Persuadés de tenir un bon filon, ses cofondateurs Simon Gazikian et Alain Blancquart sont ambitieux et pressés : il veulent que MyDataModels devienne une licorne, startup valorisée à plus d'un milliard d'euros... dans cinq ans maximum.

Compenser les inconvénients du big data avec le "small data"

Si l'exploitation des big data a pu être popularisée au cours des années 2000, c'est notamment grâce à l'augmentation de la capacité de stockage et de la puissance des ordinateurs. Ces progrès technologiques ont permis de faire fonctionner des algorithmes d'apprentissage profond, une forme d'intelligence artificielle particulièrement gourmande en ressources informatiques. Ceux-ci excellent dans l'analyse de grands volumes de données et permettent de faire émerger des modèles prédictifs auparavant inaccessibles.

Les entreprises les utilisent, par exemple, pour anticiper leur flux de vente afin de mieux organiser leur gestion des stocks et de la logistique. Ces algorithmes ont de nombreux champs d'application, mais aussi des limites. "Ce sont des opérations coûteuses et longues, qui n'ont pas toujours les résultats escomptés", tempère le cofondateur Simon Gazikian. L'exploitation des big data requiert en outre des compétences spécifiques, et du temps pour tirer de la valeur des données.

Par conséquent, "80% des données accumulées par les entreprises ne sont pas exploitées car elles restent dans les départements, aux mains des experts métiers", s'avance Simon Gazikian. Cette gigantesque masse de données est en revanche très fragmentée, dans des quantités insuffisantes pour obtenir des résultats intéressants avec l'apprentissage profond. C'est pourquoi l'entrepreneur utilise le terme de "small data" pour parler de ces jeux de données.

"Beaucoup d'employés collectent des données dans des logiciels comme Excel ou Tableau. On peut y faire des bilans, des analyses, mais pas de prédiction", remarque le dirigeant.

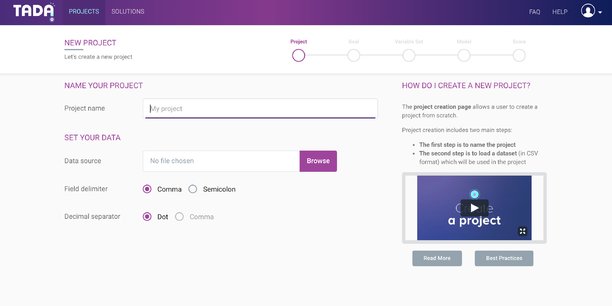

Tada, le logiciel de MyDataModels, vient apporter en plus une couche algorithmique, capable de faire émerger des modèles prédictifs. Pour parvenir à des résultats exploitables à partir d'une si petite quantité de données, la startup s'appuie sur des algorithmes dont elle est propriétaire, mis au point au bout de trois ans de recherche en Californie. Ils appartiennent à la famille des algorithmes génétiques, une sous-classe des algorithmes d'apprentissage machine. Ils permettent de résoudre des problèmes d'optimisation qui ne disposent pas de solutions connues, en suivant un modèle similaire à la sélection naturelle. L'algorithme compare deux options, identifie la plus pertinente qu'il conserve, avant de réitérer l'opération, jusqu'à sortir le meilleur résultat. "Nous avons débloqué des verrous majeurs sur ce type d'algorithmes", affirme Simon Gazikian, sans donner plus de détails pour des raisons concurrentielles. Tada a tout de même des limites : il ne peut traiter que des données textuelles et structurées, ce qui exclut les images.

Un partenariat avec l'Inria pour garder son avantage compétitif

MyDataModels a déjà sorti plusieurs cas d'usages pour Tada : prédiction des fraudes dans les secteurs de la banque et de l'assurance, prédiction du flux d'abonnements et de désabonnements à un service, mais aussi des prédiction dans le domaine médical. Des chercheurs du CNRS en médecine génomique utilisent par exemple le logiciel pour prédire des comportements de cancers du poumon. Mais le logiciel ne se limite pas à ces applications et pourrait potentiellement s'appliquer à tous les domaines.

Pour garder leur avantage compétitif, les dirigeants ont signé un contrat de recherche sur trois ans avec l'Inria, un des instituts de pointe en intelligence artificielle, basé à Sophia-Antipolis-Méditerranée. Cet engagement "proche du million d'euros" leur donne accès aux calculateurs de l'institut mais aussi à son expertise. Marc Schoenaur, directeur de recherche à l'Inria et co-auteur du rapport Villani sur l'IA, a rejoint le conseil d'administration de la startup, pour donner son point de vue autant sur les aspects commerciaux que scientifiques. La startup a éprouvé ses algorithmes dans un travail commun avec l'Inria sur la prédiction de la fertilité d'un groupe de vingt taureaux. Désormais, ils élaborent ensemble une méthode pour horodater les données nativement, ce qui ferait gagner beaucoup de temps dans la préparation des données. Ce projet leur a permis de faire partie des 75 lauréats du concours i-lab 2019, organisé par le ministère de l'enseignement supérieur, de la recherche et de l'innovation.

De grandes ambitions en attente de résultats

Pas de doutes sur les ambitions de MyDataModels. La startup veut devenir une géante du secteur de l'intelligence artificielle, et même une licorne, startup valorisée à un milliards d'euros. Pour se faire, ses deux cofondateurs n'ont pas lésiné sur les moyens. En plus du partenariat avec l'Inria, relativement coûteux pour une si petite structure, la startup compte déjà près de 30 employés. Pourtant, elle n'a levé qu'un million d'euros pour l'instant, en janvier 2019, à peine neuf mois après sa création, auprès du fonds allemand Earlybird. La jeune pousse ne communique pas sur son chiffre d'affaire. Surtout, elle ne compte pour l'instant qu'une très petite poignée de clients, parmi lesquels le fabriquant de cartes SIM Gemalto, du groupe Thalès. Mais Simon Gazikian est confiant. Il laisse entendre qu'il aurait déjà refusé une offre d'acquisition intéressante de la part d'un des Gafa, et anticipe une levée de fonds plus importante à la fin de l'année.

Pour gagner le marché, Tada s'appuie sur un modèle freemium : certaines fonctionnalités sont accessibles à tous, mais il faut débourser 2.950 euros par mois pour profiter de la version débridée du logiciel, et 12.500 euros pour profiter de services d'accompagnement. Afin de ne se fermer aucune débouché, MyDataModels peut déployer Tada sous forme de licence bureautique, sur cloud public ou sur cloud privé selon l'envie de ses clients. Le logiciel est également accessible sur la place de marché de Amazon Web Services, et sera intégré à d'autres plateformes d'IoT. A peine deux ans après les premières preuves de concept de leur technologie, les dirigeants de MyDataModels s'attaquent donc au marché pied au plancher. L'objectif : s'installer avant l'arriver des acteurs américains et chinois. Simon Gazikian met en garde :

"Sur le traitement du big data, l'Europe est derrière les Etats-Unis. Mais sur le traitement de la small data, nous ne sommes pas derrière. Il faut doter l'Europe, car d'ici deux ou trois ans, il y aura une transformation dans le commerce de ce type de logiciels."

Emploi : les vraies raisons des vagues de départs des salariés français

Emploi : les vraies raisons des vagues de départs des salariés français

Sujets les + commentés