Bruxelles a présenté mercredi sa proposition de règlement sur l'intelligence artificielle. Pour promouvoir un développement "éthique" de ces technologies dans l'UE, l'exécutif européen privilégie une évaluation au cas par cas des risques induits. La Commission préconise des amendes pouvant grimper jusqu'à 6% du chiffre d'affaires annuel mondial ou 30 millions d'euros au maximum.La Commission européenne milite pour une intelligence artificielle (IA) "de confiance". C'est ce qu'il ressort de sa proposition de règlement sur le sujet dévoilée mercredi, un an après la publication de son livre blanc sur le sujet. Présenté par Bruxelles comme "le tout premier cadre juridique sur l'IA" au monde, ce projet vise à réguler la création d'intelligences artificielles utilisées en Europe. Le but : promouvoir une vision vertueuse de l'IA et empêcher certaines dérives déjà observées à l'étranger, comme le recours massif à la reconnaissance faciale en Chine pour alimenter un système de notation et de crédit social des citoyens.

Entre la Chine et les Etats-Unis, l'exécutif européen cherche donc à proposer une troisième voie pour le développement d'une IA plus éthique - comme elle l'a déjà fait en 2018 avec le RGPD, qui a établi de nouveaux standards pour la protection des données personnelles.

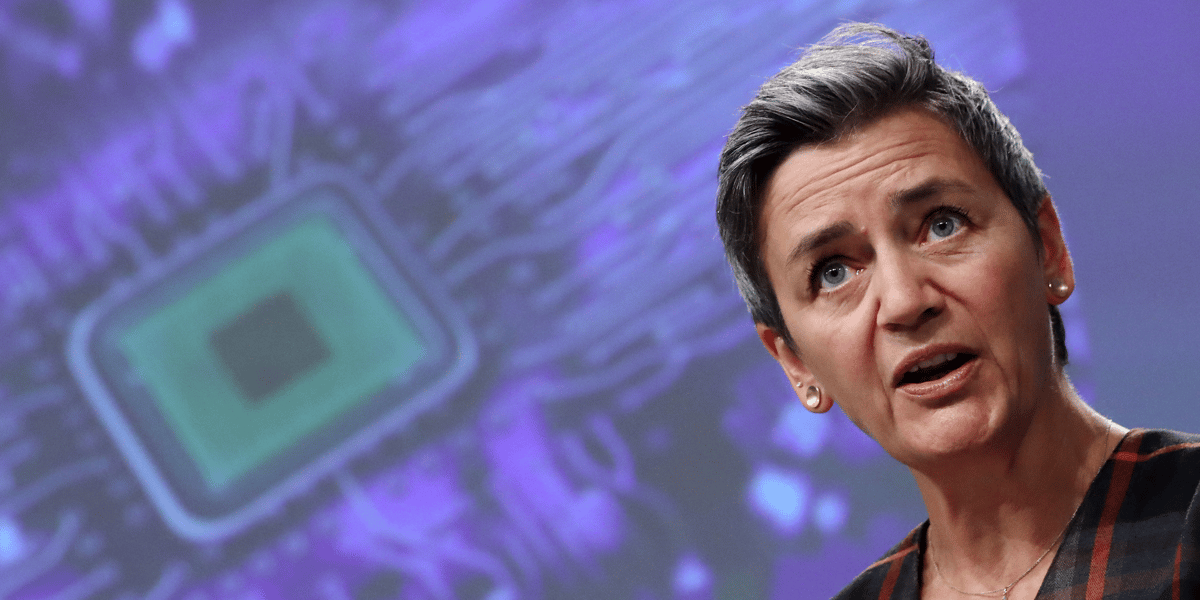

"En adoptant ces règles qui feront date, l'UE prend l'initiative d'élaborer de nouvelles normes mondiales qui garantiront que l'IA soit digne de confiance", a affirmé mercredi Margrethe Vestager, vice-présidente de la Commission européenne en charge du numérique et de la concurrence.

Et de poursuivre : "En établissant les normes, nous pouvons ouvrir la voie à une technologie éthique dans le monde entier, tout en préservant la compétitivité de l'UE."

Adapter la régulation au risque supposé

Réguler des technologies comme l'IA n'est pas une mince affaire. "Le temps de la Commission n'est pas toujours celui des marchés - encore plus dans l'innovation et le numérique", commente Matthieu Lucchesi, avocat spécialisé en stratégie juridique et réglementaire dans le domaine de l'innovation au sein du cabinet Gide Loyrette Nouel. Etant donné que ces technologies sont en évolution permanente, "il faut réussir à poser un cadre suffisamment précis pour être viable et opérationnel, sans figer la réglementation."

C'est pourquoi l'exécutif mise sur une évaluation des risques au cas par cas. L'idée : adapter le contrôle et la régulation en fonction d'un risque supposé.