La startup française Mistral AI s'attaque pour de bon à la domination de OpenAI, moins d'un an après sa création. Après avoir fait ses armes sur des modèles d'intelligence artificielle de petite taille et levé près de 500 millions d'euros, la jeune pousse a présenté ce lundi Mistral Large. Ce très grand modèle de langage est destiné à concurrencer frontalement GPT-4 d'OpenAI et Gemini de Google, les modèles d'IA les plus performants au monde.

Pour parvenir à ses fins, Mistral a décidé de combattre le feu par le feu, puisqu'il signe, comme OpenAI, un partenariat de distribution (le seul, pour l'instant) avec Microsoft pour son nouveau modèle phare. Cet accord s'accompagne d'un investissement minoritaire (dont le montant exact est gardé secret) au capital de l'entreprise de la part du géant américain, qui a déjà investi plus de 13 milliards dans OpenAI. Alors que Mistral se présentait comme un champion de l'open source en septembre 2023 lors de son lancement opérationnel, et laissait entrevoir une voie alternative, il propose désormais ses meilleures modèles sous le même mode d'accès que OpenAI. Était-ce le prix à payer pour concurrencer les meilleurs ?

Mistral délaisse l'open source pour la performance

A son lancement, Mistral se présentait comme le nouveau « fer de lance » des modèles ouverts, un rôle qu'endossait jusque-là Meta avec sa gamme de modèles Llama. « Nous pensons qu'une approche ouverte à l'IA générative est nécessaire », écrivait l'entreprise, afin de « combattre la censure et les biais dans une technologie qui va modeler notre futur. » L'open source [la publication en accès libre de nombreuses informations techniques sur le modèle, ndlr] était présenté comme la voie idéale pour faire face à « l'oligopole émergent », c'est-à-dire à la mise en place d'un marché seulement composé d'une poignée d'acteurs américains, dont le duo OpenAI-Microsoft et Google, poursuivi par quelques startups très bien financées (Anthropic, Cohere, Inflection AI...). Seul Meta avait pris cette voie.

Dès le lancement de son premier modèle en septembre 2023, la startup a séduit les spécialistes de l'IA, tant par son approche que par ses performances comparées aux modèles fermés. Un second modèle, publié trois mois plus tard et surnommé « Mixtral » par ses utilisateurs, finissait de convaincre le secteur du sérieux et du potentiel de la jeune pousse. Cette dernière laissait entrevoir la possibilité qu'un champion de l'open source parvienne à surpasser les performances des géants américains. Mais dès novembre 2024, Arthur Mensch expliquait que les modèles de Mistral ne seraient pas tous ouverts. Lors de la conférence Artificial Intelligence Marseille organisée par La Tribune, il expliquait déjà que le fait d'avoir opté, dans un premier temps, pour la publications de modèles à code ouvert, « ne veut pas dire qu'on ne développe pas de modèles propriétaires ».

Désormais, la startup dissocie sur son site ses modèles « ouverts », et ses modèles « optimisés » synonymes de fermés. Autrement dit, son activité se compose de deux gammes. Arthur Mensch assume pleinement cette stratégie dans son interview accordée au Monde, et précise qu'elle était prévue dès le début, en plus de rassurer sur l'investissement futur de son entreprise dans l'open source . Reste que Mistral, qui voulait « fermer l'écart de performance entre les solutions boîtes noires et les solutions ouvertes » à son lancement, fait finalement lui-même cet écart au sein de ses propres solutions. Sur X, le cofondateur et directeur scientifique de l'entreprise Guillaume Lample présente le nouveau modèle fermé Mistral Small, qui n'est accessible qu'en passant par la plateforme de la startup ou par le cloud de Microsoft à l'instar de Mistral Large, comme « une alternative significativement plus performante » que son équivalent open source Mixtral...

Mistral sur la voie royale

En s'écartant de l'open source, Mistral résout en partie le problème de la monétisation de ses modèles. Certes, il avait déjà signé des accords avec les plus gros hébergeurs de cloud (Microsoft Azure, Google Cloud et Amazon Web Services) pour distribuer ses modèles contre rémunération, ainsi que lancé sa propre plateforme, bien nommée La Plateforme, pour les distribuer lui-même. Mais en parallèle, ses modèles pouvaient être exploités par n'importe quelle entreprise sans passer par Mistral ou un hébergeur, grâce à l'open source. En passant en mode fermé, les utilisateurs seront contraints de mettre la main au portefeuille pour utiliser les modèles Mistral Large ou Mistral Small, que ce soit en passant directement par Mistral ou par le cloud de Microsoft.

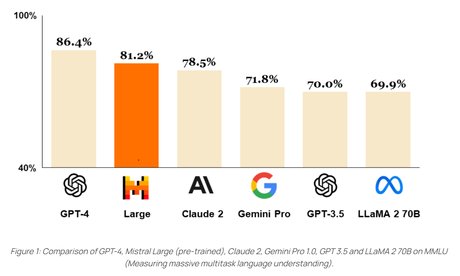

Les entreprises vont forcément être tentées, car avec Mistral Large, la startup a enfin son produit d'appel, la démonstration qu'elle peut vraiment faire aussi bien que les meilleurs. Dans son blog de présentation du modèle, elle utilise pas moins de sept benchmarks [tests de performance, ndlr] pour prouver son propos, avec pour résultat le graphique ci-dessous. Elle se présente comme meilleure que les IA de Google et Anthropic, étant seulement devancé par GPT-4 au général, tout en étant meilleur sur certaines tâches.

Pour aller encore plus loin dans son opération séduction des entreprises, Mistral a sorti un équivalent de ChatGPT, nommé Le Chat, afin qu'elles puissent tester gratuitement les capacités de Mistral Large, qui sert de moteur à l'outil.

Non seulement, Mistral fait aussi bien que les meilleurs, mais il le fait avec moins. Au Wall Street Journal, Arthur Mensch explique que Mistral Large a coûté moins de 20 millions d'euros à produire, là où le dirigeant d'OpenAI Sam Altman expliquait que GPT-4 avait coûté entre 50 millions et 100 millions de dollars à entraîner, soit plus du double. La startup française est également bien moins financée que ses concurrents, et a une équipe d'une taille bien moins importante. Faire aussi bien, voire mieux, avec moins est le mantra de la startup depuis son lancement, et elle répond pour l'instant à ses promesses.

Emploi : les vraies raisons des vagues de départs des salariés français

Emploi : les vraies raisons des vagues de départs des salariés français

Sujets les + commentés