« Nous avons besoin de plus de GPU. Alors mesdames et messieurs, permettez-moi de vous présenter un très, très gros GPU », a annoncé lundi soir Jensen Huang, fondateur et dirigeant de Nvidia, devant plus de 11.000 spectateurs. À l'occasion de la grande messe annuelle de l'entreprise, la GTC de San Jose, l'homme d'affaires a présenté sa très attendue nouvelle architecture de GPU, ces processeurs essentiels à la création des meilleurs modèles d'intelligence artificielle.

Nommée en l'honneur du mathématicien David Harold Blackwell, la nouvelle puce est près de deux fois plus grosse que sa prédécesseure Hopper, que s'arrachent depuis un an grandes entreprises et gouvernements aux quatre coins du monde. « C'est la plus grosse puce physiquement possible », a fait valoir Jensen Huang pour souligner l'avancée réalisée. Derrière ce changement d'architecture, une promesse : permettre aux développeurs d'intelligences artificielles, comme OpenAI, Google ou Mistral AI de créer des modèles d'IA jusqu'à dix fois plus gros, et donc, en théorie plus performants.

Blackwell, nouvelle machine à cash de Nvidia

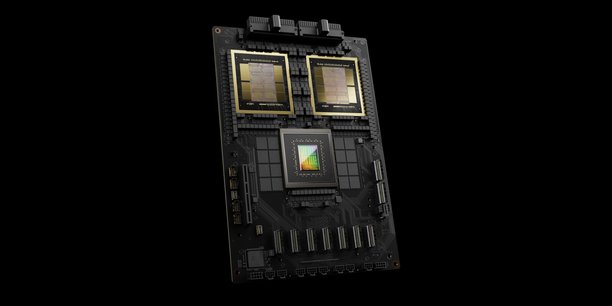

Pour s'y retrouver dans l'offre de Nvidia, il faut imaginer un système de poupées russes : Blackwell désigne une puce, qui n'est pas vendue séparément. Le premier produit de l'entreprise est la GB200, une « superpuce » dixit l'entreprise, qui embarque deux Blackwell et un autre type de processeur, connectés entre eux. Puis Nvidia peut lier plusieurs GB200 au sein d'un même serveur, c'est-à-dire une armoire où sont rangées plusieurs « superpuces ». Et enfin, elle peut connecter plusieurs armoires entre elles, pour créer de véritables supercalculateurs dédiés à l'IA, voire même un datacenter entier. Si le terme GPU désigne à l'origine seulement la puce, Jensen Huang l'utilise aussi pour nommer chacune de ces poupées russes.

Comme d'habitude, le prix des produits de Nvidia n'est pas public. « Elle vaut dix milliards de dollars », ironise le dirigeant en désignant la « superpuce » GB200 qu'il porte dans sa main. Son équivalent d'ancienne génération, la H100, se vendait entre 30.000 et 40.000 dollars l'unité, le prix des serveurs entiers pouvait, quant à lui, dépasser les 350.000 dollars d'après la presse spécialisée. Puisque Nvidia prend une marge de près de 80% sur la facture grâce à sa situation de quasi monopole, il a pu exploser ses bénéfices sur les trois derniers trimestres. Sauf incident, Blackwell devrait prendre le relais de Hopper comme machine à cash de l'entreprise, afin d'adresser un marché que Jensen évalue à terme supérieur à 1.000 milliards de dollars.

« C'est d'ores et déjà le lancement de produit le plus réussi de notre histoire », se félicite le dirigeant. Et pour cause,alors que sa puce n'est même pas encore sur le marché, Nvidia a signé 41 entreprises clientes, dont les principaux fournisseurs de cloud (Amazon Web Services, Microsoft Azure, Google Cloud), mais aussi des entreprises comme Oracle, IBM, Dell, OpenAI ou encore le français Scaleway.

Blackwell, plus rapide et moins énergivore

Dans le flot de chiffres destiné à démontrer l'intérêt de sa technologie, Jensen Huang a marqué le coup avec un graphique sur l'accélération des capacités de calcul permise par ses GPU.

« En huit ans, nous avons accéléré par 1.000 la vitesse de calcul. Au meilleur de la loi de Moore, cette multiplication n'était que de 100 tous les dix ans », a-t-il détaillé, sous les applaudissements de la salle. Concrètement, le premier DGX, sorti en 2016, permettait d'atteindre 0,17 petaflops [une unité qui mesure le nombre de calculs par seconde d'une machine, ndlr]. Le nouveau DGX atteint quant à lui une puissance de 720 petaflops...

Plus précisément, l'entraînement d'un modèle d'IA du calibre de GPT-4, la référence du secteur déployé par OpenAI en mars 2023, mobilisait 8.000 GPU Hopper sur trois mois, pour une consommation électrique totale de 15 mégawatts. D'après Jensen, le même entraînement peut être effectué avec seulement 2.000 Blackwell, pour une consommation totale de 4 mégawatts.

Nvidia promet donc à sa clientèle de réduire le coût de développement des modèles actuels, tout en ouvrant de nouvelles perspectives sur des modèles plus gros. Mieux, puisque Blackwell a été pensé spécifiquement pour l'inférence - le fonctionnement des modèles une fois qu'ils ont été entraînés -, il serait 30 fois plus rapide que la génération précédente et pourrait ainsi répondre à bien plus de requêtes d'un assistant d'IA, par exemple.

La concurrence encore loin derrière

Avec ce nouveau coup d'accélérateur, Nvidia renforce un peu plus son monopole sur le marché de l'IA. Si l'entreprise se détache de la concurrence par ses architectures de puces, elle creuse encore plus l'écart par tout l'écosystème autour de ses GPU. Par exemple, une nouvelle technologie, intégrée aux serveurs, vient tester en permanence chaque composant du circuit, dans le but de détecter en amont toute défaillance. Tandis que le Nvlink, un processeur chargé d'optimiser toujours plus le transfert d'information entre les différents GPU, vient de recevoir une nouvelle itération. Une autre technologie, le Infinity Band, permet de faire communiquer à grande échelle les plus grandes machines de Nvidia, sans perte d'information.

Ou encore, une des plus grosses machines de Nvidia, le GB200 NVL72, chauffe tellement que pour optimiser ses performances, l'entreprise a dû développer un système de refroidissement liquide, comme en ont les PC de très haut de gamme. Concrètement, des tubes d'eau passent autour des serveurs et absorbent la chaleur qu'ils émettent. « L'eau rentre à une température ambiante et ressort à une température parfaite pour un jacuzzi », s'est amusé Jensen, tout en précisant que le système injecte deux litres d'eau par seconde. Encore un exemple d'un dispositif complémentaire qui permet à l'entreprise américaine d'asseoir sa domination sur la concurrence. Derrière, les géants AMD et Intel paraissent bien loin, tout comme les spécialistes Cerebras et Grocq...

Emploi : les vraies raisons des vagues de départs des salariés français

Emploi : les vraies raisons des vagues de départs des salariés français

Sujets les + commentés