Les experts s'accordent : dans le milieu des processeurs, qui dit intelligence artificielle dit Nvidia. L'entreprise a dépassé les 1.000 milliards de dollars de valorisation en début de semaine car elle dispose d'un quasi-monopole sur les processeurs utilisés dans l'entraînement des nouveaux modèles d'IA générative -comme ChatGPT-, très demandeur en capacité de calcul.

Pris de court, les autres constructeurs veulent aussi leur part du gâteau, à commencer par les acteurs historiques du marché, Advanced Micro Technologies (AMD) et Intel. Pour y parvenir, ils misent sur le lancement à court terme de leurs nouveaux processeurs dédiés à l'IA. Mais le pari n'est pas gagné pour autant. Explication.

Un marché à mille milliards de dollars ?

Dans une interview à CNBC, le cofondateur et CEO de Nvidia estime que le marché naissant de l'IA dans les data center pourrait peser à terme plus de 1.000 milliards de dollars. Certes, cette estimation provient du premier convaincu par la technologie. Mais elle reflète tout de même l'engouement généralisé du secteur, visible dans les allées particulièrement chargées du Computex, un des salons de référence pour les constructeurs de serveurs. « Même les industriels qui font peu d'informatique vont vouloir s'intéresser à l'IA », prédit Sean Chen, responsable marketing chez le fournisseur de serveurs Gigabyte, pendant que les visiteurs se pressent autour des machines de Nvidia sur son stand.

« Nous assistons avec l'avènement des LLM [les grands modèles de langages comme GPT-4, ndlr] à une nouvelle vague de l'intelligence artificielle, bien plus demandeuse en puissance de calcul. Le problème, c'est que les avancées de performance des serveurs n'arrivent plus à suivre l'explosion de la taille des nouveaux modèles d'IA », explique à La Tribune Stella Weng, analyste chez Digitimes. « Concrètement, là où il fallait auparavant un processeur de type GPU pour faire tourner une IA, il en faut maintenant huit pour entraîner un LLM », précise-t-elle.

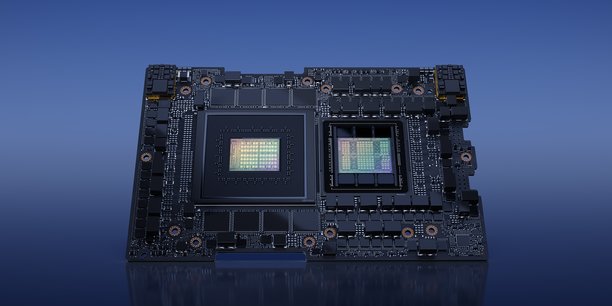

Puisque les serveurs dédiés à l'IA doivent embarquer plus de GPU, leur prix moyen explose. « Les serveurs n'ont jamais coûté aussi cher. Pour trouver des montants similaires, il faut regarder du côté du calcul de haute performance, et encore », observe Dylan Patel, auteur de SemiAnalysis, une newsletter de référence sur les processeurs. Par exemple, une des dernières machines dédiées aux LLM présentées par Nvidia, la DGX H100, coûte plus de 270.000 dollars car elle embarque 8 GPU haut de gamme. En revanche, selon les estimations du consultant, Nvidia dégagerait un profit brut de 190.000 dollars par vente de serveur, un montant de l'ordre du jamais vu. C'est donc après ces sommes que courent les constructeurs concurrents.

AMD en tête des poursuivants

En tête des poursuivants -mais loin derrière Nvidia- se trouve AMD. Ce pilier du secteur des semi-conducteurs, à l'agonie à la fin des années 2000, connaît un second souffle depuis l'arrivée en 2014 d'une nouvelle dirigeante, Lisa Su. Pour redresser la barre, la CEO s'est d'abord concentrée sur l'offre de processeurs pour PC, et ce n'est que récemment que l'entreprise a investi lourdement sur le marché de l'IA. Elle a notamment racheté le constructeur Xilinx en 2022 pour près de 50 milliards de dollars.

Si AMD produit aujourd'hui plusieurs gammes de processeurs pour datacenter, aucune n'est taillée pour concurrencer la gamme dédiée à l'IA de Nvidia. Mais cette situation n'est que temporaire, puisque courant juin, AMD va présenter sa puce MI300, pensée pour les tâches d'IA et disponible dès la fin de l'année. Cette étape devrait donner une première estimation de sa capacité à grignoter des parts de marché à Nvidia.

« Les investisseurs s'intéressent à AMD parce qu'ils le voient comme le Nvidia du pauvre. Ils pensent que le marché va être tellement gros que AMD n'a pas forcément besoin d'être à un niveau compétitif pour s'en tirer », estime Stacy Rasgon, analyste chez Bernstein, dans les colonnes Forbes. Lors de ses derniers résultats trimestriels, Nvidia a présenté un carnet de commandes largement supérieur aux attentes, mais il a concédé qu'il devrait drastiquement augmenter sa production pour répondre à la demande. Cette déclaration a inquiété une partie des analystes quant à la capacité de l'entreprise à s'ajuster, et AMD pourrait bien profiter de l'embouteillage qui se profile pour convaincre des clients impatients.

Le troisième géant du secteur, Intel, part quant à lui d'encore plus loin, puisqu'il prévoit de lancer de nouveaux processeurs dédiés aux LLM pour 2025. « Pour AMD et Intel, rejoindre Nvidia en termes de performance va être difficile, mais je ne vois pas le marché laisser Nvidia faire cavalier seul », estime Sean Chen.

Nvidia a trop d'avance dans le logiciel

D'après les experts interrogés par La Tribune, la capacité des poursuivants à rattraper Nvidia reste pourtant très limitée. « Je n'ai aucun doute sur le fait que AMD, Intel et même d'autres puissent construire une puce similaire à celle de Nvidia », affirme Dylan Patel, avant de poursuivre, « en revanche, ils sont très loin d'avoir un écosystème logiciel aussi performant. » Stella Weng va même plus loin : « Nvidia n'est plus un simple constructeur de puces, c'est devenu un architecte d'écosystème de serveur ».

Concrètement, Nvidia a une avance colossale sur toutes les technologies qui entourent les GPU. Il a par exemple créé des puces spécialisées -les NVLink et les NVSwitch- chargées d'optimiser la communication entre les différentes GPU d'un même serveur, afin d'optimiser les calculs. L'entreprise a aussi acquis en 2020 Mellanox, le numéro deux du marché des réseaux, pour 7 milliards de dollars. Ce rachat lui a permis de déployer Infinity Band, une technologie pour améliorer la communication entre les serveurs, là aussi pour limiter les pertes d'information entre les différentes machines.

Mais ce n'est pas tout : une fois que les clients entrent dans l'écosystème logiciel de Nvidia, il devient très compliqué d'en sortir. Car l'entreprise l'alimente depuis plus d'une décennie, et multiplie les nouveautés ces derniers mois. « Une des principales raisons qui empêche AMD de rattraper son retard, c'est que bon nombre de développeurs ne savent pas utiliser ses logiciels », observe Stella Weng. Autrement dit, quand bien même la concurrence arriverait à recoller à Nvidia en termes de performances de calcul, les entreprises pourraient tout de même décider de rester fidèles. « Si vous changez d'environnement logiciel, il faut recompiler toutes vos applications d'entreprise, ce qui demande du temps et de l'argent », rappelle Sean Chen. Le règne de Nvidia ne devrait donc pas se terminer de sitôt.

Nucléaire : après 12 ans de retard, EDF va enfin mettre en service l’EPR de Flamanville

Nucléaire : après 12 ans de retard, EDF va enfin mettre en service l’EPR de Flamanville

Sujets les + commentés